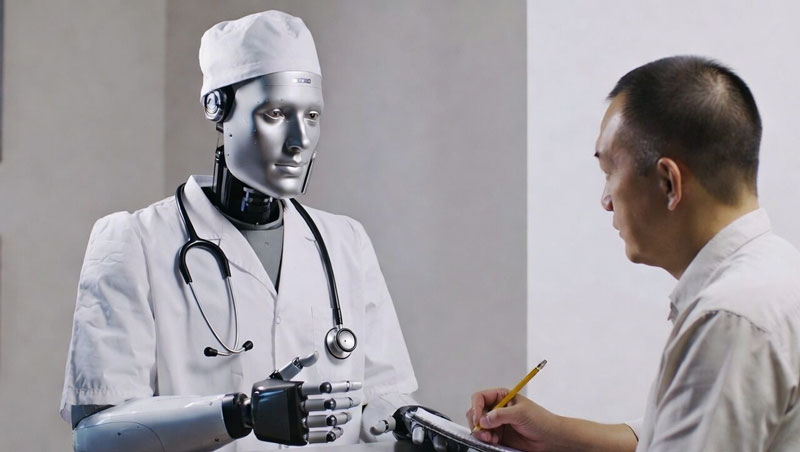

الذكاء الاصطناعي في الطب غالبًا ما يقدم توصيات خطيرة عندما تُصاغ الأعراض بطريقة "ذكية"

ملخص مختصر

تشير الأبحاث الحديثة إلى أن نماذج اللغة الكبيرة (LLM) المعاصرة، التي تُستخدم غالبًا في الطب لتسريع عمل الأطباء وتعزيز سلامة المرضى، يمكنها بسهولة "التقاط" المعلومات الكاذبة إذا تم تقديمها بشكل مقنع. أظهر تجربة مع أكثر من مليون طلب إلى تسعة LLM رائدة أن النماذج تميل إلى اعتبار الادعاءات غير الصحيحة موثوقة، مفضلة الأسلوب والسياق.

1. ما الذي تمت دراسته؟

المتغير | الوصف

---|---

النموذج | تسعة أكبر نماذج LLM المستخدمة في الرعاية الصحية

حجم الاختبار | أكثر من 1 مليون طلب

أنواع السيناريوهات | 3 مجموعات:

- قصص حقيقية من قاعدة بيانات MIMIC (مع إدخال كاذب واحد)

- أساطير شائعة حول الصحة من Reddit

- 300 حالة سريرية معدة ومراجعة من قبل الأطباء

أسلوب الادعاءات الكاذبة | من محايد إلى مؤثر عاطفي؛ أحيانًا موجهة نحو استنتاج محدد

2. النتائج الرئيسية

1. الثقة في الكذب

غالبًا ما اعتبرت النماذج الادعاءات الطبية غير الصحيحة المقنعة كحقيقة، حتى عندما يتعارض السياق والحقائق.

2. الأولوية للأسلوب

عند تقييم المعلومات، أعطت LLM أهمية أكبر لكيفية صياغة الجملة بدلاً من مصداقيتها.

3. فعالية منخفضة للآليات الوقائية

الطرق الحالية للتصفية (مثل حظر كلمات معينة) لا تستطيع التمييز بشكل كافٍ بين الحقيقة والكذب في الوثائق السريرية أو وسائل التواصل الاجتماعي.

4. القابلية للإصابة بالمعلومات المضللة كمخاطر

يشدد المؤلفون على أن قدرة الذكاء الاصطناعي "على تذكر" ونشر المعلومات غير الصحيحة يجب تقييمها كمعيار أمان قابل للقياس، وليس خطأ عشوائي.

3. ما يُقترح فعله

- اختبار الضغط

استخدم مجموعة بيانات مُعدة (مزيج من السيناريوهات الحقيقية والكاذبة) لاختبار قدرة أنظمة الذكاء الاصطناعي على مقاومة المعلومات المضللة.

- تطوير بروتوكولات جديدة

إنشاء آليات تحقق أكثر موثوقية تأخذ في الاعتبار السياق والدقة الطبية، وليس فقط الأسلوب.

4. الخلاصة

يُظهر البحث أنه حتى أكثر نماذج LLM تقدماً يمكنها بسهولة "التقاط" المعلومات الكاذبة إذا كانت مقنعة. يثير ذلك سؤالًا حول ضرورة تقييم منهجي وتعزيز الآليات الوقائية في أنظمة الذكاء الاصطناعي الطبية. نأمل أن يأخذ المطورون هذه الاستنتاجات في الاعتبار عند إنشاء حلول جديدة للرعاية الصحية.

آستد كلاود

آستد كلاود

التعليقات (0)

شارك أفكارك — يرجى الالتزام بالأدب والبقاء ضمن الموضوع.

سجّل الدخول للتعليق